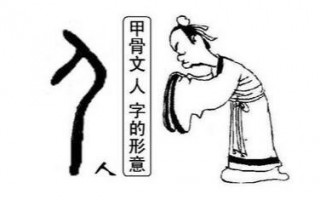

一、一张照片,背后隐藏着什么?

我们每天刷到的明星照片,大多是媒体发布、拍摄,还是品方的宣传图?其实,这些照片背后,有一部分已经不再是传统意义上“拍摄”出来的,而是“生成”出来的。

三、明星图片识别的背后,是一场关于信任的

我们为什么会相信一张图片?

二、明星图片识别:你看到的,未必是真的

面对这种情况,一种新的技术也随之兴起:明星图片识别。

四、普通人如何应对这场“信任危机”?

既然AI技术已经无阻挡地进入了我们的生活,那我们该怎么办?

:

- 保持惕,理性判断:看到令人震惊的图片或视频,先别急着转发,多查证来源,看看是否有其他平台同步报道。

- 学会使用识别工具:目前市面上已经有一些简单的AI图片识别工具(如反向搜索、图像分析等),可以用来辅助判断。

- 多角度实信息:比如看背景是否合理、光线是否自然、表情是否统一等,AI生成的图片往往在细节上存在破绽。

- 提高媒介素养:教育下一代如何辨别真假信息,是未来必须面对的重要课题。

- 不制造、不传播内容:每个人都是信息传播者,也应该是信息守护者。

五、AI换脸,不只是技术问题,更是问题

AI换脸和明星图片识别的出现,本质上是一场技术带来的挑战。

AI换脸,这项技术原本是为了影视、角替换等专业用途而研发的。但随着开源工具的普及,这项技术已经走出了专业圈,进入了生活。只要你有一张明星的照片,再找一张普通人的脸,用AI工具几秒钟就能完成“换脸”。

“这是真的吗?”

下一次,当你刷到一张让你震惊的明星照片时,请先问自己一句:

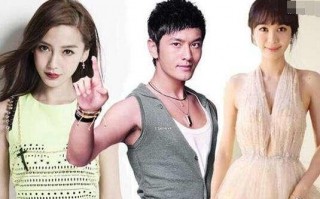

你可能刷到过这样的内容:某明星穿着从未公开过的衣服,出现在你从没见过的场合,甚至做出一些非常夸张的表情或动作。你以为是独家料,其实只是某人用AI生成的“伪照”。

你愣住了——怎么连明星的脸都靠不住了?

刷短视频的时候,看到一张熟悉的明星脸,穿着性感礼服,笑容甜美地对镜头眨眼,你忍不住点了个赞,转发给朋友说“你看,XXX今天真美”。结果朋友一句话泼了你一头冷水:“这是AI换的脸吧,假的。”

因为图片是视觉证据,是“眼见为实”的。但在AI,这个“实”已经不再可靠。

因为,你看到的,未必是真相。

在这个真假难辨的,我们或许无阻止AI的入侵,但我们可以选择不被它牵着走。

它不仅改变了我们获取信息的方式,更在潜移默化中改变着我们对“真实”的定义。

它的出现,本意是为了帮助辨别真假信息,但在实际应用中,它也带来了一些新的问题。

想象一下:

我们不能阻止技术的进步,但我们可以选择用更成熟、更理性的态度去面对它。

未来,也许我们会看到更多AI生成的明星内容,也许我们会习惯“看到的不一定是真的”。但无论如何,保持独立思考、提升辨别能力、守护真实信息的边界,是我们每个人的责任。

比如:

这不仅影响的是明星本人的形象管理,更深层次地,它动摇了整个对“真实”的认知基础。

这导致了一个非常严重的现象:明星图像泛滥。

这并不是危言耸听。近年来,随着人工智能技术的迅猛发展,一种名为“明星图片识别”的技术开始在社交平台上悄然蔓延。我们看到的明星照片,很可能不是他们本人,而是别人用AI技术“合成”的。更可怕的是,这种技术已经越来越成熟,越来越难以分辨真假。

这项技术的心,就是通过AI算分析图片中的面部特征、光影变化、背景细节,来判断这张图片是否为AI生成,或者是否经过换脸处理。

- 识别准确率并不高:目前市面上的识别技术,面对高仿真度的AI图片,判断失误率依然较高。

- 技术门槛低,误用风险大:很多人用识别工具随便一查,就断言某张图是假的,甚至引发。

- 真假难辨,信任危机:当真假界限越来越模糊,公众对明星形象的信任也在逐渐瓦解。

更值得的是,一些不分子利用AI换脸技术制造视频、图片进行诈、、甚至性,给带来了极大的安全隐患。

- 如果你看到某位明星在某个场合做出不当行为的照片,你会不会立刻转发、评论、甚至愤怒?

- 如果你看到某位明星与某品合作的海报,你会不会认为这是真实的合作?

- 如果你看到某位明星发布的内容,你会不会认为那是他/她本人的真实想?

但这些,都可能只是AI合成的结果。而我们,正在一步步失去对图像的信任。

你刷到的明星美照,竟不是本人?AI换脸已悄悄入侵你的生活

你有没有这样的经历?

相关问答